プレスリリース

Gemma 2 2Bのテキスト生成能力やコストパフォーマンスを活かしつつ日本語能力を強化

rinna株式会社 (本社:東京都渋谷区/代表取締役:宋 珠憲、以下rinna) は、Gemma 2 2Bに対して日本語継続事前学習と指示学習を行った「Gemma 2 Baku 2B」シリーズを開発し、Gemma Terms of Useで公開したことを発表します。

■ rinnaのモデル公開活動

生成AIは多くの製品で活用され始め、急速に普及しています。この普及の背景には、高性能な基盤モデルが利用しやすいライセンスで公開されていることが挙げられます。rinnaでは、日本のAI技術発展のために、日本語のタスクに適したGPT・BERT・HuBERT・CLIP・Stable Diffusionなど、テキスト・音声・画像に関する基盤モデルを公開してきました。2021年4月からHugging Faceに公開してきたrinnaのモデルは、累計690万ダウンロード、1100件を超えるLikesを記録しており、多くの研究・開発者に利用されています。

そしてこの度、より使いやすく高性能な日本語LLMを目指し、Google社が公開している大規模言語モデル (LLM: large language model) であるGemma 2 2Bに対し、日本語継続事前学習した「Gemma 2 Baku 2B」と、指示を遂行するように指示学習した「Gemma 2 Baku 2B Instruct」を開発し、公開しました。これらのモデル公開が、日本のAI研究・開発の一助となれば幸いです。

・Gemma 2 2Bの日本語継続事前学習モデル「Gemma 2 Baku 2B」シリーズ

https://huggingface.co/collections/rinna/gemma-2-baku-66fa41973c7ffa7931528388

■ 「Gemma 2 Baku 2B」シリーズの特徴

Gemma 2 2Bは、26億パラメータとLLMの中ではパラメータ数が少ない軽量なモデルではあるものの、高いテキスト生成能力を備えています。パラメータ数が少ないため、利用目的に合わせた追加学習が容易です。また、推論時のコストパフォーマンスも高く、高性能なGPUを搭載していないオンデバイスでの利用も期待されます。「Gemma 2 Baku 2B (rinna/gemma-2-baku-2b)」は、Gemma 2 2Bに対し、日本語と英語の学習データ800億トークンを使用して継続事前学習したモデルであり、Gemma 2 2Bの日本語能力を強化しています。「Gemma 2 Baku 2B Instruct (rinna/gemma-2-baku-2b-it)」は、Gemma 2 Baku 2Bに対して、Chat VectorとORPOという手法を用いて指示学習を行ったモデルです。Gemma 2 Baku 2B Instructは人間との対話に適しており、Hugging Face の Spaces で気軽にお試しいただけます。Gemma 2 Baku 2Bシリーズは、Gemma Terms of Use を継承しており、このライセンスに従いご利用いただけます。「Baku」というモデル名の由来は、妖怪の「獏」からきています。

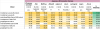

図1と図2はGemma 2 2Bシリーズ、Gemma 2 Baku 2Bシリーズ、Llama 3 8Bシリーズ、Llama 3 Youko 8B(rinnaが開発したLlama 3 8Bの日本語継続事前学習モデル)シリーズにおける、日本語LLMベンチマークJapanese MT-BenchとJapanese LM Evaluation Harnessの結果です。ベンチマークの結果から、Gemma 2 Baku 2Bシリーズは、オリジナルのGemma 2 2Bシリーズより日本語の性能が改善していることがわかります。特に、対話性能を評価するJapanese MT-Benchの結果は、80億パラメータのLlama 3 Youko 8B Instructより26億パラメータのGemma 2 Baku 2B Instructが高いスコアを達成しています。詳細なベンチマーク結果は、こちらで確認できます。

[画像1: https://prcdn.freetls.fastly.net/release_image/70041/59/70041-59-78ef91a11e931ad2ed1b149d7ecc842d-2317x490.png?width=536&quality=85%2C75&format=jpeg&auto=webp&fit=bounds&bg-color=fff ]

図1:Japanese MT-Benchスコア

[画像2: https://prcdn.freetls.fastly.net/release_image/70041/59/70041-59-3f52ade54b405e61e53d3f9fe4787456-2370x692.png?width=536&quality=85%2C75&format=jpeg&auto=webp&fit=bounds&bg-color=fff ]

図2:Japanese LM Evaluation Harnessスコア

■ 今後の展開

ChatGPTの登場によりテキスト生成の技術は気軽に利用できるようになりましたが、目的のタスクを実現するためのテキスト生成や低コスト化・セキュリティ強化等のためには、利用目的に則したモデルの開発・運用が重要となります。これまでにrinnaでは、LLMを用いた多くの研究・開発・運用により、知見を十分に蓄えており、LLMの導入を検討している法人のお客様に対して、ビジネスや事業目的に適したLLMのカスタマイズソリューション「Tamashiru Custom」を提供しています。本モデルの開発を通して、これまで以上にお客様の目的に適したカスタムLLMを提供することが可能となりました。今後も、AIの社会実装を進めるために研究開発を続け、研究成果の公開や製品への導入を行っていきます。生成AIの活用やカスタムLLMをご希望の方はお問い合わせください。

【rinna株式会社について】

「人とAIの共創世界」(Co-creation world between humans and AI) をビジョンに掲げたAI企業です。テキスト・音声・画像・動画などの生成系AIモデルの研究開発や人工知能によるデータ分析が強みです。研究成果である各種AI技術を活用し、パートナー企業とともにさまざまなビジネス課題を解決するソリューションの開発と提供に取り組んでいます。また、フラグシップAI「りんな」の技術をもとに生み出した、親しみの持てる多様性あふれる「AIキャラクター」を通して人とAIが共に生きる豊かな世界を目指しています。

※文中の社名、商品名などは各社の商標または登録商標である場合があります。

プレスリリース提供:PR TIMES